A Apple anunciou, nesta quinta-feira (05), uma atualização de segurança e privacidade com foco nos usuários menores de idade, que cobre três áreas de seus serviços. São elas: novos recursos de segurança no aplicativo de mensagens, detecção de conteúdo e material de abuso sexual infantil (Child Sexual Abuse Material [CSAM]) no iCloud e uma atualizações na Siri, a assistente virtual da Apple, para que ela avise os país, caso seus filhos estejam interessados em pornografia infantil.

- A Amazon quer ter acesso ao interior de todos os prédios para 'facilitar a entrega'

- Cuba bloqueia acesso à redes sociais após onda de protestos em Havana

- Audacity pode ser um spyware russo e você nem imaginava

Essa atualização obedecem ao compromisso recente da Apple com a segurança e a privacidade de seus usuários. Não foi informado data de lançamento, apenas que vai estar disponível para usuários dos Estados Unidos ainda este ano, com o lançamento dos sistemas iOS 15, iPadOS 15 e macOS Monterey.

"Queremos ajudar a proteger as crianças de predadores que usam ferramentas de comunicação para recrutá-los e explorá-los, e limitar a disseminação de Material de Abuso Sexual Infantil (CSAM) [...] Este programa é ambicioso e proteger as crianças é uma responsabilidade importante. Esses esforços irão evoluir e se expandir com o tempo", escreve a empresa em um comunicado em seu site oficial.

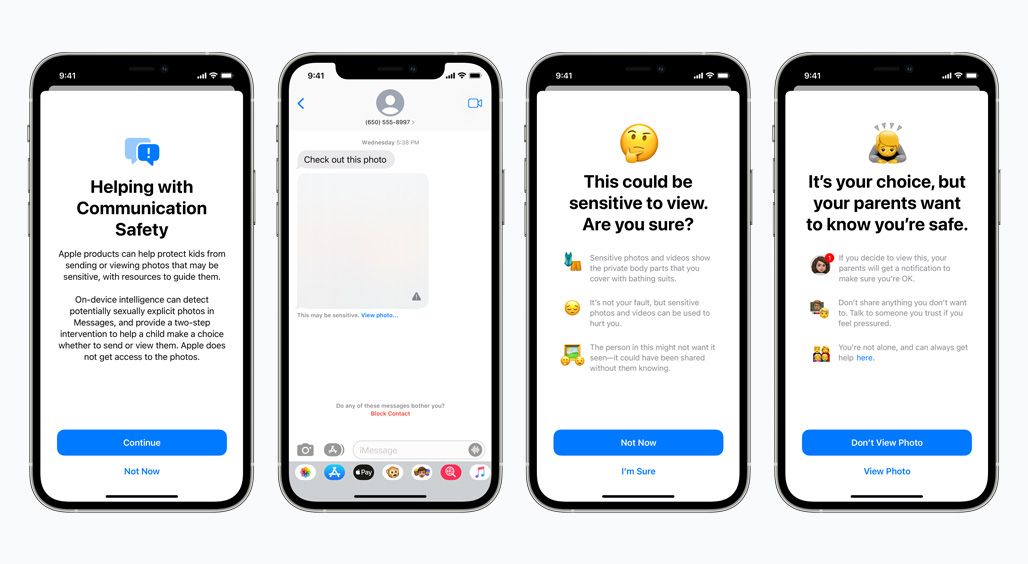

Segundo a empresa, a atualização do aplicativo de mensagens, por exemplo, vai alertar o usuário (e seus pais, caso seja menor de idade) antes de enviar e receber uma mensagem com conteúdo sexual explicito. Ou seja, o aplicativo de mensagens da Apple, vai utilizar inteligência artificial para determinar se há conteúdo sexual explícito em fotos recebidas e enviadas por seus usuários.

Embora "seja um recurso projetado para que a Apple não tenha acesso às mensagens", para identificar conteúdo sexual nas mensagens, o aplicativo precisa analisar e ter acesso aos conteúdos que estão sendo enviados e recebidos pelo usuário.

Especialistas questionam

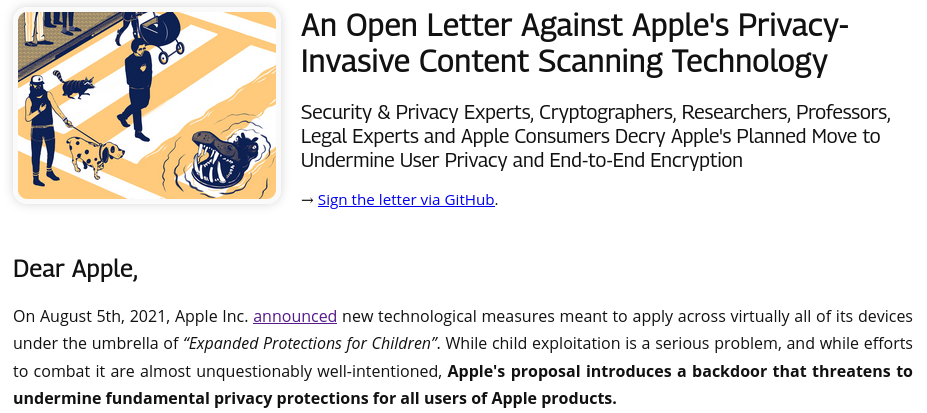

Após o anúncio, especialistas em tecnologia, segurança da informação e privacidade manifestaram suas dúvidas e questionamentos com relação às possíveis brechas de segurança e privacidade que podem ser exploradas nessa nova atualização. Uma das principais questões é com relação ao possível abuso da ferramenta por polícias e órgão governamentais, já que a atualização permite que a Apple escaneie as bibliotecas de fotos inteiras de seus usuários, em busca de imagens de pornografia infantil.

De acordo com o CSO Online, mais de 4 mil especialistas (profissionais de segurança, ativistas de privacidade, criptógrafos, pesquisadores, professores, juristas e clientes Apple) assinaram uma carta aberta contra a tecnologia que a empresa quer implantar ainda este ano. Um desses especialistas é Edward Snowden, o ex analista de sistemas da CIA e NSA, que tornou público os detalhes da operação de espionagem e vigilância global do Governo dos Estados Unidos em 2013. "A proposta da Apple apresenta um backdoor que ameaça e enfraquece princípios fundamentais da privacidade de dados", disse Snowden.

Já o professor de criptografia, Matthew Green, explica com mais detalhes como governos autoritários podem abusar de brechas legais criadas por essa nova atualização para monitorar e espionar seu povo.

"Essa é uma ideia realmente ruim [...] Essas ferramentas permitirão que a Apple escaneie as fotos do seu iPhone em busca de fotos que correspondam a um hash perceptivo específico e as relate aos servidores da Apple se muitos aparecerem [...] Eventualmente, pode ser um ingrediente chave para adicionar vigilância aos sistemas de mensagens criptografadas.", disse Green no Twitter.

Além destes, outras personalidades do como Will Cathcart, o responsável pelo WhatsApp, do Facebook e Tim Sweeney, CEO da Epic Games manifestaram suas críticas à nova atualização, que teoricamente buscam mais privacidade às crianças, mas expõe a população toda à governos controladores.

Fontes: Apple; CSO Online; Apple Privacy Letter; Matthew Green.